Google‚جچl‚¦‚éپuگس”C‚ ‚éAIپv‚ئ‚ح

Google‚ھپA”NژںٹJ”ژزƒJƒ“ƒtƒ@ƒŒƒ“ƒXپuGoogle I/Oپv‚إپuگس”C‚ ‚éAIپv‚ض‚جژpگ¨‚ًگà–¾‚µ‚½پB‚»‚ج“à—e‚ئ‚حپB

پ@پuChatGPTپv‚جƒٹƒٹپ[ƒX‚ًٹْ‚ةپAگ¶گ¬AIپiگlچH’m”\پj‚جگi‰»‚ة‘ه‚«‚بٹْ‘ز‚ھڈW‚ـ‚èپA‚³‚ـ‚´‚ـ‚ب•ھ–ى‚ة‚¨‚¢‚ؤٹˆ—p‚ج‰آ”\گ«‚ھŒں“¢‚³‚ê‚ؤ‚¢‚éپBˆê•û‚إپA‚»‚ج‹Zڈp‚ھ‚ح‚ç‚قƒٹƒXƒN‚ة‚آ‚¢‚ؤ‚à‹cک_‚ھٹھ‚«‹N‚±‚èپA‚ا‚ج‚و‚¤‚بƒ‹پ[ƒ‹گ®”ُ‚ًگi‚ك‚ê‚خ‚و‚¢‚ج‚©پAٹeچ‘‚جگ•{‚â–¯ٹش‘gگD‚ھ‚³‚ـ‚´‚ـ‚ب—§ڈê‚⃌ƒxƒ‹‚إŒں“¢‚ًگi‚ك‚ؤ‚¢‚é‚و‚¤‚¾پB

پ@•ؤGoogle‚حپA2018”N‚ةپuAIŒ´‘¥پv‚ً’è‚ك‚ؤAI‚جچ\’z‚ة‚¨‚¢‚ؤپuپwگس”C‚ ‚éAIپxƒAƒvƒچپ[ƒ`‚ًژو‚邱‚ئ‚ة–±‚ك‚ؤ‚«‚½پv‚ئ‚µ‚ؤ‚¢‚éپB2023”N5Œژ10“ْپiŒ»’nژٹشپj‚ة“¯ژذ‚ھٹJچأ‚µ‚½”NژںٹJ”ژزƒJƒ“ƒtƒ@ƒŒƒ“ƒX”NپuGoogle I/Oپv‚إ‚حپAƒWƒFپ[ƒ€ƒYپEƒ}ƒjƒJژپپi‹ZڈpپEژذ‰ï’S“–ڈم‹‰•›ژذ’·پj‚ھ“¯ژذ‚جƒAƒvƒچپ[ƒ`‚ًپu‘ه’_‚ةپAڈي‚ةگس”C‚ًژ‚ء‚ؤپv‚ئ‚¢‚¤Œ¾—t‚إ•\Œ»‚µپA“¯ژذ‚جپuگس”C‚ ‚éAIپv‚ض‚جژpگ¨‚ًگà–¾‚µ‚½پB‚»‚ج“à—e‚ئ‚حپB

Google‚جچl‚¦‚éپuگس”C‚ ‚éAIپv‚ئ‚ح

پ@Google I/O‚جٹî’²چu‰‰‚إ‚حژه‚ةAI‚ةٹض‚·‚éƒeپ[ƒ}‚ةڈd“_‚ھ’u‚©‚êپAGoogleƒ}ƒbƒv‚âŒںچُƒGƒ“ƒWƒ“پAGoogleƒtƒHƒg‚جAI‹@”\‚جگi‰»‚âپAGoogle Workspace‚ض‚جƒ`ƒƒƒbƒgAIپuBardپv‚ج“K—pپA‚»‚ê‚ç‚جAI‹@”\‚ًژx‚¦‚é‘ه‹K–حŒ¾Œêƒ‚ƒfƒ‹پuPaLM 2پv‚جگi‰»‚ب‚ا‚ھڈذ‰î‚³‚ꂽپB‚»‚ج’†‚إ‚àژگـپuResponsibleپiگس”C‚ ‚éپjپv‚ئ‚¢‚¤Œ¾—t‚ھŒJ‚è•ش‚µ‹’²‚³‚ꂽپB

پ@ƒ}ƒjƒJژپ‚àپuAI‚ج‘ه’_‚بƒuƒŒپ[ƒNƒXƒ‹پ[‚ً–ع‚ج‘O‚ة‚µ‚ؤ‹»•±‚ًٹo‚¦‚é‚ھپAAI‚ح•s“–‚ب•خŒ©‚ب‚اپAٹù‘¶‚جژذ‰ï“I‰غ‘è‚ًˆ«‰»‚³‚¹‚é‰آ”\گ«‚ھ‚ ‚éپv‚ئ‚µ‚ؤ“¯ژذ‚ھ2018”N‚ةڈ‰‚ك‚ؤگ§’肵‚½پuAIŒ´‘¥پv‚ة‚ج‚ء‚ئ‚ء‚ؤپAپuگس”C‚ ‚éAIپvƒAƒvƒچپ[ƒ`‚ًˆسژ¯‚µ‚ب‚ھ‚çچ\’z‚µ‚ؤ‚¢‚é‚ئگà–¾‚µ‚½پB

پ@AI‚ة‚ـ‚آ‚ي‚éƒٹƒXƒN‚ج’†‚إ‚àپA“¯ژذ‚ھ“ھ‚ً”Y‚ـ‚¹‚ؤ‚¢‚é‰غ‘è‚جˆê‚آ‚ھپuٹشˆل‚ء‚½ڈî•ٌپv‚ًگ¶گ¬‚·‚邱‚ئ‚¾‚ئ‚¢‚¤پBگ¶گ¬AI‚ة‚و‚ء‚ؤگV‚µ‚¢ƒRƒ“ƒeƒ“ƒc‚ًچى‚邱‚ئ‚ھ—eˆص‚ة‚ب‚ء‚½‚ھپA‚»‚ê‚ة‚و‚ء‚ؤٹشˆل‚ء‚½ڈî•ٌ‚ھWebڈم‚ة‘‚¦‚ê‚خپAWebڈم‚جڈî•ٌ‘S‘ج‚جگM—ٹگ«‚ھ’ل‰؛‚µپAWebŒںچُ‚ج‰؟’l‚ھ’ل‰؛‚·‚邱‚ئ‚ة‚ب‚éپB

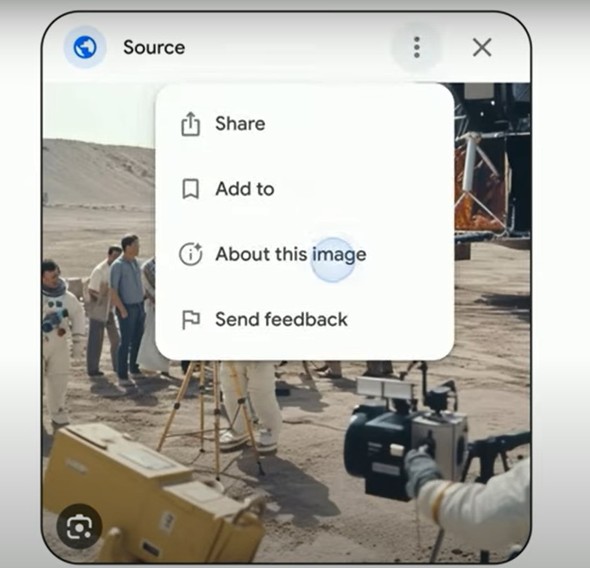

پ@‚±‚ê‚ة‘خ‚µ‚ؤپAچ،Œمگ”ƒJŒژ‚جٹش‚ةGoogleŒںچُ‚ج‹@”\‚ئ‚µ‚ؤپu‚±‚ج‰و‘œ‚ة‚آ‚¢‚ؤپv‚ئ‚¢‚¤‹@”\‚ً’ا‰ء‚µپA‰و‘œ‚ھچإڈ‰‚ة•\ژ¦‚³‚ꂽژٹْ‚âڈêڈٹپA‰و‘œ‚ةٹضکA‚·‚éƒjƒ…پ[ƒX‚âژ–ژہ‚ًٹm”F‚إ‚«‚é‚و‚¤‚ة‚ب‚é‚ئ‚¢‚¤پB

پ@پuپw‚±‚ج‰و‘œ‚ة‚آ‚¢‚ؤپxپv‚ج‹@”\‚ًژg‚¦‚خپAŒژ–ت’…—¤‚ً‰‰ڈo‚µ‚½‰و‘œ‚ھAI‚ة‚و‚ء‚ؤگ¶گ¬‚³‚ꂽ‚à‚ج‚إ‚ ‚邱‚ئ‚ًژw“E‚·‚éƒjƒ…پ[ƒX‹Lژ–‚ًŒ©‚邱‚ئ‚à‚إ‚«‚ـ‚·پB‚±‚ê‚ç‚ج”wŒiڈî•ٌ‚ة‚و‚ء‚ؤپA‰و‘œ‚ھگM—ٹ‚ة’l‚·‚é‚©‚ا‚¤‚©‚ً”»’f‚إ‚«‚ـ‚·پvپiƒ}ƒjƒJژپپj

پ@‚ـ‚½پAGoogleŒںچُ‚إAI‚ھگ¶گ¬‚µ‚½‰و‘œ‚ة‚آ‚¢‚ؤ‚حپA‚»‚جژ–ژہ‚ھ–¾ٹm‚ة•\ژ¦‚·‚é‚ئ‚¢‚¤پB

پ@‚³‚ç‚ةGoogle‚ھٹJ”’†‚جپuUniversal Translatorپv‚ةٹض‚·‚锕\‚à‚ ‚ء‚½پBUniversal Translator‚حگl•¨‚ج”کb‚ًٹî‚ةپAکbژز‚جگO‚ج“®‚«‚ًˆê’v‚³‚¹‚ب‚ھ‚特گ؛‚ً–|–َ‚إ‚«‚éƒTپ[ƒrƒX‚¾پB‚±‚ê‚حپAŒêٹwٹwڈK‚ب‚ا‚جپuŒ¾Œê‚جڈK“¾پv‚ة‚¨‚¢‚ؤ—L‰v‚بƒcپ[ƒ‹‚إ‚ ‚éˆê•ûپAƒfƒBپ[ƒvƒtƒFƒCƒN‚ب‚ا‚ةˆ«—p‚³‚ê‚é‰آ”\گ«‚ھ‚ ‚éپB‚»‚±‚إGoogle‚حپA‚±‚جƒTپ[ƒrƒX‚ةƒAƒNƒZƒXگ§Œہ‹@”\‚ً•t—^‚·‚鑼پAگ¶گ¬‚³‚ꂽ“®‰و‚ة‘خ‚µ‚ؤپA“dژq“§‚©‚µ‚ج‚و‚¤‚بژd‘g‚ف‚àچج—p‚·‚é‚ئ‚µ‚½پB

پ@پ@ƒ}ƒjƒJژپ‚حGoogle‚ھپuAIŒ´‘¥پv‚âپuگس”C‚ ‚éAIپv‚ًˆسژ¯‚µ‚ؤ“G‘خ“IƒeƒXƒg‚ًژ©“®‰»‚·‚éژو‚è‘g‚ف‚ًگi‚ك‚ؤ‚«‚½‚±‚ئپA‚³‚ç‚ة‰¹گ؛چ‡گ¬‚ًŒںڈo‚إ‚«‚éƒcپ[ƒ‹‚ًٹJ”’†‚إ‚ ‚邱‚ئ‚à”âکI‚µ‚½پB

پ@ƒ}ƒjƒJژپ‚ھچإŒم‚ةپuگس”C‚ ‚éAI‚جچ\’z‚ج‚½‚ك‚ة‚حپAŒ¤‹†ژز‚âژذ‰ï‰بٹwژزپAٹe‹ئٹE‚جگê–ه‰ئپAگ•{پAƒNƒٹƒGƒCƒ^پ[پAڈo”إژذپA‚»‚µ‚ؤ“ْڈيگ¶ٹˆ‚إAI‚ًژg—p‚·‚éگlپX‚ج‘چ—ح‚ًŒ‹ڈW‚·‚é•K—v‚ھ‚ ‚éپv‚ئ‚µ‚ؤGoogle‚ھ‚»‚جƒGƒRƒVƒXƒeƒ€‚جˆê’[‚ً’S‚¤‚±‚ئ‚ً‹’²‚µ‚½پB

پ@AI‚جƒٹƒXƒN‚ة‘خ‚·‚é”Fژ¯‚ئƒ‹پ[ƒ‹گ®”ُ‚ة‚آ‚¢‚ؤ‚حپAٹeچ‘‚إ‚à‚»‚جژو‚è‘g‚ف‚ھگi‚ٌ‚إ‚¢‚éپB‰¢ڈBˆدˆُ‰ï‚ھ2021”N4Œژ‚ةپuResponsible AIپvپiگس”C‚ ‚éAIپj‚جژہŒ»‚ً–عژw‚·—د—ƒKƒCƒhƒ‰ƒCƒ“‚ً”•\‚µ‚½‘¼پA•ؤچ‘‚àFRBپiکA–Mڈ€”ُگ§“xپj‚ب‚ا‚جٹeڈب’،‚ھ–@گ®”ُ‚ًگi‚ك‚ؤ‚¢‚éپB“ْ–{‚إ‚à‹à—Z’،‚âŒoچدژY‹ئڈب‚ھAI‚ةٹض‚·‚é—د—ƒKƒCƒhƒ‰ƒCƒ“‚ً”•\‚µپA‚±‚ê‚ةŒؤ‰‚·‚é‚©‚½‚؟‚إ‘هژèITٹé‹ئ‚ھژںپX‚ةAI’ٌ‹ں‚ة‚¨‚¯‚éژذ‰ï“Iگس”C‚جژو‚è‘g‚ف‚ًŒِ•\‚µ‚½پB

پ@‚³‚ç‚ةپA’¼‹ك‚إ‚ح2023”N4Œژ30“ْ‚ةŒQ”nŒ§چ‚چèژs‚إٹJ‚©‚ꂽژه—v7ƒJچ‘پiG7پjƒfƒWƒ^ƒ‹‹Zڈp‘ٹ‰ïچ‡‚ة‚¨‚¢‚ؤ‚àپA5Œژ‚جG7چL“‡ƒTƒ~ƒbƒg‚إگ¶گ¬AI‚جƒٹƒXƒN‚ة‚آ‚¢‚ؤ‹c‘è‚ةڈم‚°‚邱‚ئ‚ھŒˆ‚ـ‚ء‚ؤ‚¢‚éپB

پ@‚³‚ـ‚´‚ـ‚بژںŒ³‚إپuResponsible AIپv‚ً–عژw‚µ‚½“®‚«‚ھچ‚‚ـ‚é’†پAچ،‰ٌ‚جGoogle‚ج•\–¾‚à‚»‚ج’ھ—¬‚ج’†‚ة‚ ‚é‚ئŒ¾‚¦‚éپB

Copyright © ITmedia, Inc. All Rights Reserved.