なぜ今、小規模言語モデル(SLM)なのか? Microsoftによる生成AIのトレンドと実用例

生成AIが登場してから約2年がたち、現在は実用フェーズへ移行する企業も増えている。生成AIをビジネスの現場でどのように活用し、競争力を高めればいいか、日本マイクロソフトの担当者が実践的なヒントを紹介した。

Microsoft Copilot(以下、Copilot)の普及に力を入れる日本マイクロソフトでは、企業の生成AIに対する取り組みを4つのステージに分類している。「生成AIの評価/検証」「AIプラットフォームの整備」の段階は生成AIを使うステージ、「ビジネス実装」「独自AI Agent実装」の段階は生成AIを創るステージだ。

自社の生成AIに関する成熟度を上げるためには、現在地を把握して、次のステージに進む必要がある。日本マイクロソフトの小田健太郎氏(Asia Azure Data&AI GTM Manager)が、AIを創るステージにフォーカスして、小規模言語モデル(SLM:Small Language Model)やMulti- Modal(マルチモーダル)/Multi- Model(マルチモデル)といった現在のトレンドや、それらの導入事例について紹介した。

生成AIのトレンドはLLMからSLMへ

大規模言語モデル「LLM」から小規模言語モデル「SLM」へのパラダイムシフトが起きている。小田氏はSLMを使うメリットを4つ挙げた。まず、SLMは価格が安いことが特徴だ。トークンあたりにかかるコストが安く、一般的なLLMと比較してトータルコストを抑えられる。

2つ目は、LLMは莫大な計算資源が必要な一方で、SLMは少ない計算資源で動くことだ。SLMはモバイルデバイスやエッジデバイスを使ったオフライン環境でも機能するためポータビリティがある。

3つ目は、小規模なモデルゆえに推論のスピードが速いことで、4つ目は、カスタマイズのしやすさだ。自社のデータを基にファインチューニングをしたり、長文のプロンプトを挿入したりすることが可能だという。これら4つのメリットからSLMが大きな注目を集めている。

MicrosoftのSLM「Phi-3シリーズ」 オンデバイスモデルの「Phi-Silica」も実装を開始

Microsoft Researchが開発したSLMに「Phi-3シリーズ」がある。LLMの汎用性に対して、SLMは固有のタスクに特化して作られた生成AIだ。LLMとSLMを上手に使い分けるのが現在のトレンドだという。

Phi-3シリーズのうち、「Phi-Silica」はデバイス組み込むためのモデルだ。MicrosoftではすでにPhi-Silicaを搭載したPCを発売している。「Copilot+PC」と呼ばれる製品で、OEMメーカーも搭載を始めている。クラウドやインターネットにつなぐことなく生成AIを稼働できる点が特長だ。

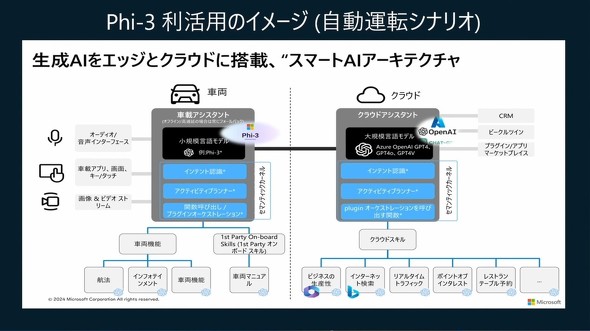

Phi-3シリーズの導入により、車両や工場の端末やセンサーではエッジデバイスやスマートデバイスに搭載されたSLMを活用し、クラウド環境ではLLMを用いて学習や推論をさせるといった連携処理が可能になった。

その連携処理の一例として自動車メーカーが進めている「スマートAIアーキテクチャ」がある。車載の小規模言語モデルには、車両の速度や障害物などの情報を分析させて、車両マニュアルを基に運転手に助言をする。クラウド側の大規模言語モデルには、検索などの膨大な処理が必要な作業を任せて、「周辺のエンタメ施設を検索して」といった曖昧な自然言語による依頼にもこらえられるようにする。家族構成を登録して、子ども向けの情報を提案させるなどのシナリオも考えられる。

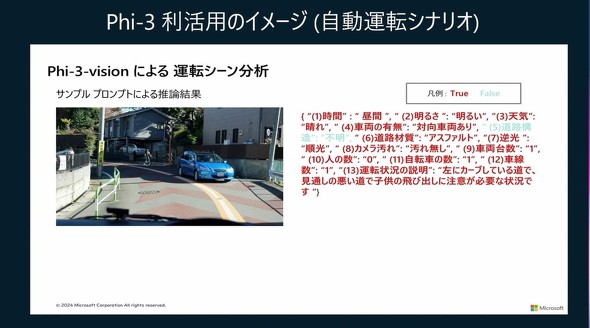

小田氏は車載の「Phi-3-vision」を使って映像から運転シーンを分析するユースケースも紹介した。時間帯は「昼間」、明るさは「明るい」、天気は「晴れ」、対向車の有無は「対向車あり」、道路構造は「不明」のように状況を整理し、分析できる。

テキストや数値以外にも複数の形式を扱える「マルチモーダル」

小田氏は、生成AIのキートレンドであるマルチモーダルとマルチモデルの違いを説明した。

マルチモーダルは、テキストや音声、画像、数値など複数の情報を基に回答を出力し、マルチモデルは、用途に応じて複数のモデルを使い分ける方式を指す。一般的には同一のタスクに利用することが多い。

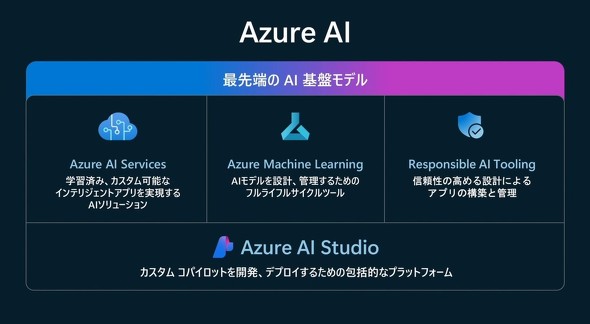

「Azure AI」は、Microsoftが提供しているAIサービスの総称だ。その中でも肝となるのが「Azure AI Services」と「Azure AI Studio」だという。Azure AI ServicesにはさまざまなAIサービスが含まれており、小田氏はその中でも特に注目を集めている「Azure OpenAI Service」について詳しく語った。

Azure AI Servicesの中核を担う「Azure OpenAI Service」

Azure OpenAI Serviceは、OpenAI社が提供するモデルをMicrosoftのマネージドサービスとして提供しているもので、OpenAIで使えるモデルは、Azure OpenAI Serviceでも使える。

Azure OpenAI Serviceの強みは、セキュリティを確保した上で、他のAzureサービスなどとレゴブロックのように組み合わせられることだ。このサービスは、Azure AIのエコシステムの中で中心的な役割を果たしているという。

Azure OpenAI Serviceを介して使える「GPT-4o/GPT-4o mini」

小田氏は、Azure OpenAI Serviceを介して使えるモデルのうち、OpenAI社が提供している「GPT-4o」と「GPT-4o mini」を取り上げた。

GPT-4oは、マルチモーダルに対応したモデルだ。テキストや音声、画像を組み合わせて回答を生成する。前のモデルと比較してレスポンスも高速化した。

GPT-4o miniは、GPT-4oを安く、軽く、速くしたモデルだ。料金はGPT-4oの約30分の1となっている。生成AIのライフサイクルは高速で回っているので、新しいモデルを切り替えながら利用することが大切だという。

「マルチモーダルに対応したGPT-4oやGPT-4o miniの登場で生成AIの可能性が大きく広がりました。これは大きなトレンドの変化です」

マルチモーダルの活用イメージ1(テキストシナリオ)

小田氏は、マルチモーダルのユースケースを挙げた。まず、テキストの差分を抽出するシナリオだ。人事規定で、8月1日に規定された内容と、8月5日に規定された内容の差分を分析し、テキストにまとめられる。

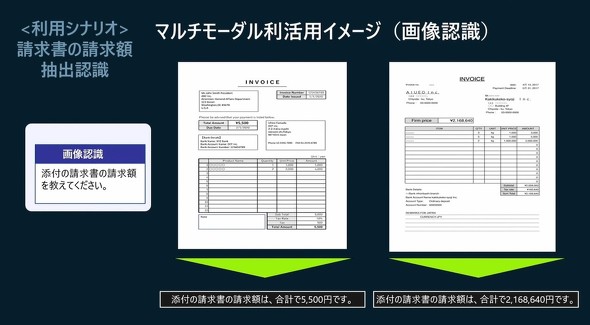

マルチモーダルの活用イメージ2(画像認識シナリオ)

請求書の画像データから請求額を抽出して合計を認識することも可能だ。経理のフォルダに営業担当者が毎月アップロードする請求書の画像データを、生成AIが読み取って計算する。

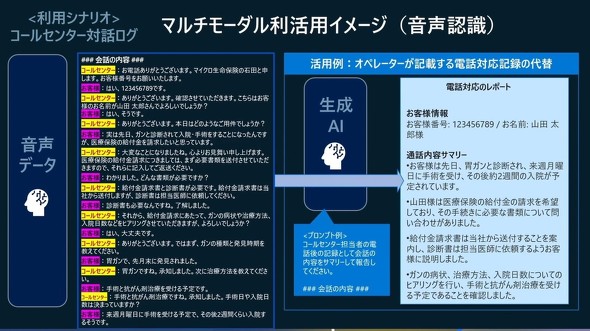

マルチモーダルの利活用イメージ3(音声認識シナリオ)

生成AIがコールセンターでの会話の内容を認識してログを作成し、ログの内容を要約してレポートにまとめ、オペレーターに助言をさせるシナリオも考えられる。

「医療保険のコールセンターに、胃がんと診断された場合の医療保険の給付金の請求方法について問い合わせがあった際には、社内の規定やマニュアルなどから給付金を請求する際には診断書が必要であることなどをアドバイスできます」

対話ログをJSON(JavaScriptのフォーマット)で構造化データとして抽出できるので、そのデータを新しい価値につなげられる。

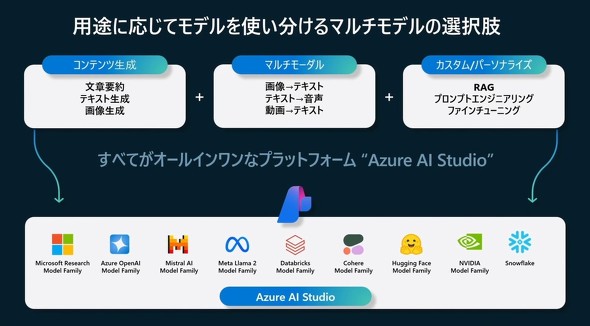

用途に応じてモデルを使い分ける「マルチモデル」の選択肢

人気のAIの用途としては、文章の要約やテキスト、画像生成などの「コンテンツ生成」、画像やテキスト、音声間の変換をする「マルチモーダル」、RAGやファインチューニングに代表される「カスタム/パーソナライズ」などが挙げられる。これらを一つのモデルでカバーすることは難しいため、用途に応じて複数のモデルを使い分ける必要がある。

マルチモデルではさまざまなモデルを管理する必要があり、そのためプラットフォームとして「Azure AI Studio」が登場した。単一のプラットフォームで複数のモデルを使い分けられる。

「MaaS」の取り組み 1700以上の「Azure AI Model Catalog」

Azure AI Studioでは、「Model Catalog」としてOpenAIが提供するGPTシリーズやMetaの「LlaMA」シリーズの他、1700以上のモデルを利用できる。Microsoftでは、モデルのエコシステムを総称して「MaaS(Models as a Service)」と呼んでいる。

Model Catalogにあるモデルは大きく3つに分けられる。汎用性のあるLLMと特定要素に特化したモデル、そして各国の言語に特化したモデルだ。

日本のマーケットやビジネスカルチャーを理解したモデルは、日本ではフラッグシップモデルになり得る。直近では日本語モデルにNTTデータの「tsuzumi」が初めて採用された。

「2024年は、実証実験段階のプロジェクトが本番環境に適用され、これまで選択肢が限られていたモデルの可能性が一気に広がると思います。今後もSLM、マルチモーダル、マルチモデルの事例が数多く出てくることを期待しています」(小田氏)

本稿は、Microsoftによるイベント「AI の無限の可能性を実用的なインパクトに変える―Microsoft の AI によるイノベーション:Azure Bootcamp」のセッションの内容を基に編集部で再構成した。

Copyright © ITmedia, Inc. All Rights Reserved.

製品カタログや技術資料、導入事例など、IT導入の課題解決に役立つ資料を簡単に入手できます。

- Google Cloudで請求300万? 攻撃者にAPIキーを抜かれた開発者の悲劇:877th Lap

- またツール選びから始めるのか 20年変わらない中小企業のIT導入

- 「デジタル化・AI導入補助金2026」攻略法 突破率9割のプロが教える落選の防ぎ方

- 2027年、情報処理技術者試験が刷新 2026年終了の試験と新設のデータ試験を徹底解説

- ChatGPTが突然バグる、入れてはいけない「NGワード」とは?:809th Lap

- 無料、GPU不要、高精度 国会図書館が作ったOCRツールを触って試す【実践レビュー】

- 資料を食わせるだけで自動化できる、「NotebookLM」の"ズルい"使いこなし術

- 「まだAS/400を使っているのか」で片付けない 古いシステムを見るときの判断軸

- 業務自動化の切り札「プロセスマイニング(Process Mining)」とは何か

- 岸博幸先生、日本の中堅企業経営に「絶望的に欠けるもの」って何ですか